低速无人驾驶感知定位技术:场景化设计与低成本实现

方案优势

解决方案

解决方案

-

组网解决方案

-

5G+行业应用

-

工业物联网

-

智慧交通

-

智慧城市

-

新零售

-

智慧农业

-

智慧电力

-

安防监控

-

智慧环保

-

智慧水务

-

能源行业

-

智慧医疗

-

商业与金融

-

-

平台解决方案

-

供暖行业

-

智慧环保

-

-

低速无人驾驶

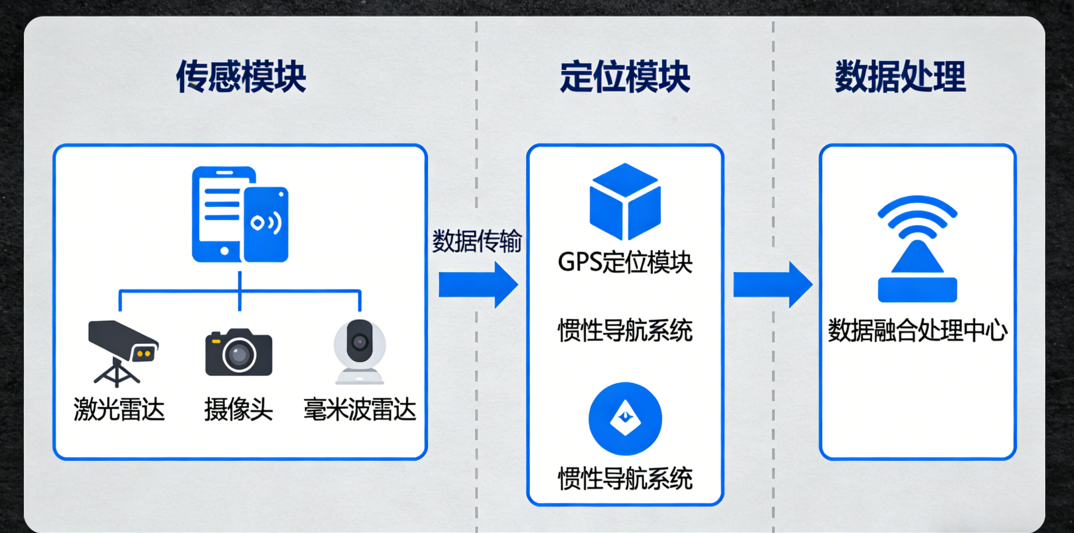

感知与定位是低速无人驾驶的核心技术底座,决定了车辆在园区、机场、矿区、城乡末端等结构化/半结构化场景中的环境理解能力和位置精度。与高速自动驾驶追求 “超视距、高冗余” 的感知定位逻辑不同,低速无人驾驶围绕“近距离高精度识别、复杂环境适配、低成本落地”三大核心需求,形成了一套专属的技术体系,其中多传感器融合、SLAM技术的场景化应用,成为技术落地的关键。

低速场景感知定位的核心需求与技术挑战

低速无人驾驶的运行场景,具有环境复杂度高、人机交互密集、信号条件受限、成本敏感四大特征,这对感知定位技术提出了针对性挑战:

●近距离全要素识别:运行速度低于40km/h,车辆与障碍物的交互距离近、反应时间短,需识别行人、宠物、台阶、减速带等各类动态 / 静态障碍,甚至判断行人行为意图,避免突发碰撞;

●复杂信号环境适配:在楼宇间、地下车库、矿区隧道等场景,GPS 信号易丢失或漂移,无法依赖单一卫星定位实现连续定位;

●密集人机交互的语义理解:需区分行人、骑行者、服务车辆等不同交互主体,提取语义信息,为决策层的社会兼容交互提供数据支撑;

●成本约束下的性能平衡:低速无人驾驶的商业化核心是替代人力,感知定位硬件方案需在满足精度要求的前提下,实现极致成本优化,避免高成本传感器堆砌。

相较于高速自动驾驶 “重性能、轻成本” 的技术导向,低速无人驾驶的感知定位技术,从设计之初就需兼顾性能适配性与商业可行性,这是其技术研发的核心逻辑。

感知系统:多传感器融合的场景化配置与精细化识别

低速无人驾驶的感知系统,摒弃了高速场景的 “高性能传感器全覆盖” 方案,采用“核心传感器为主、多传感器融合为辅”的场景化配置策略,结合深度学习算法实现精细化、低成本的环境感知。

核心传感器的选型与场景适配

不同传感器的特性决定了其在低速场景中的应用分工,核心是发挥各传感器的优势,实现功能互补:

●摄像头:作为语义识别核心,采用低成本高分辨率款型,负责车道线识别、交通标志检测、行人/车辆类别识别及行为意图判断,依托深度学习算法提取丰富的视觉语义信息,是实现人机交互理解的基础;

●毫米波雷达(24/77GHz):作为全天候感知核心,弥补摄像头在夜间、雨雾等恶劣天气下的感知短板,精准探测障碍物的距离、速度,实现前向碰撞预警、近距离避障,其全天候工作、穿透性强的特性,适配低速场景的复杂天气需求;

●固态激光雷达:作为高精度定位与轮廓识别补充,相较于机械激光雷达,固态激光雷达成本更低、体积更小、可靠性更高,负责构建周边环境的3D点云轮廓,实现障碍物精准建模,配合SLAM技术完成厘米级定位;

●超声波雷达:作为近距离微避障核心,低成本、近距离探测可靠的特性,使其成为自动泊车、站点停靠、狭窄通道避障的关键,有效识别0-5米范围内的低矮障碍(如台阶、路沿)。

低速场景的传感器组合,并非简单的硬件叠加,而是根据园区/机场/矿区/城乡末端等不同场景的特性进行定制化配置,如矿区场景强化激光雷达与毫米波雷达的抗粉尘能力,园区场景侧重摄像头的语义识别与超声波雷达的微避障能力。

深度学习驱动的精细化感知与语义提取

低速场景的感知不仅是 “检测物体”,更是 “理解环境”,深度学习算法是实现这一目标的核心技术,主要应用于三大方向:

●目标检测与行为预测:基于YOLO、Faster R-CNN等算法,实现行人、车辆、宠物等动态目标的快速检测与分类,结合LSTM网络分析目标运动轨迹,预测其行为意图(如行人是否准备横穿、车辆是否准备转弯),为决策层提供提前量;

●语义分割与环境建模:基于U-Net、DeepLab等算法,对道路、人行道、绿化带、台阶、减速带等静态环境进行语义分割,区分可行驶区域与障碍区域,构建精细化的环境语义地图;

●多任务学习提升效率:采用MTL多任务学习模型,共享骨干网络,并行输出目标检测、语义分割、深度估计等结果,在保证感知精度的同时,降低计算资源消耗,适配低速无人车的车载计算平台性能。

多传感器融合策略:低成本下的感知鲁棒性提升

单一传感器存在固有缺陷,多传感器融合是提升低速场景感知可靠性的关键,且为适配成本需求,低速无人驾驶多采用“后融合为主、前融合为辅”的策略:

●后融合(Late Fusion):各传感器独立处理数据后,在目标级进行融合,通过匈牙利算法匹配不同传感器的检测结果,加权投票确定最终目标属性。该策略计算资源需求低、容错性强,无需高算力车载平台,适配低速场景的成本与算力约束,是当前行业主流方案;

●前融合(Early Fusion):在原始数据层进行融合,如将激光雷达点云与摄像头图像像素级对齐,保留原始信息完整性,提升小目标检测能力。该策略主要应用于矿区、机场等对感知精度要求极高的低速场景,通过局部前融合弥补后融合的精度短板。

定位系统:SLAM 为核心的多源融合,实现复杂环境厘米级定位

低速无人驾驶的定位需求,是“全局连续定位 + 局部厘米级定位”,在GPS信号良好的开阔区域,实现全局位置跟踪;在GPS信号缺失的复杂区域,实现局部精准定位与避障。核心技术是以SLAM(同步定位与建图)** 为基础的多源定位融合,替代高速场景的“GNSS+IMU + 高精地图”方案,兼顾定位精度与成本。

SLAM技术的场景化应用:激光SLAM为主,视觉SLAM为辅

SLAM技术是低速无人驾驶在无GPS信号场景下的定位核心,能够通过传感器实时构建环境地图,并同时确定车辆在地图中的位置,实现定位与建图的同步完成,适配低速场景的动态环境需求。当前低速无人驾驶

中,SLAM技术的应用以激光SLAM为主、视觉SLAM为辅:

●激光SLAM:依托固态激光雷达的点云数据,结合IMU、轮速计的辅助数据,实现厘米级的定位精度,抗光照、天气干扰能力强,是园区、机场、矿区等核心低速场景的主流定位方案,能够实时构建三维环境地图,适配复杂的静态障碍布局;

●视觉SLAM:依托摄像头的视觉数据,成本更低、信息更丰富,主要应用于快递配送、社区服务等对成本高度敏感的低速场景,配合激光雷达实现局部补位,在纹理丰富的环境中(如社区道路、快递网点)实现分米级定位精度。

SLAM技术的核心优势,在于无需提前构建高精地图,能够实时适应环境变化(如临时摆放的设施、道路施工),这与低速场景中环境动态性强的特征高度匹配,而高速场景依赖的高精地图,因更新成本高、无法适配动态环境,并不适用于低速无人驾驶。

多源定位融合:补足单一 SLAM 的精度短板

为实现全场景连续、精准定位,低速无人驾驶采用“SLAM+GNSS+IMU +轮速计”的多源定位融合方案,根据场景信号条件实现自动切换与数据互补:

●GPS信号良好场景(如园区开阔道路、城乡主干道):以GNSS定位为主,SLAM、IMU为辅,实现全局连续定位,同时利用SLAM数据校准GNSS的定位漂移,提升定位精度;

●GP信号弱/缺失场景(如楼宇间、地下车库、矿区隧道):以激光SLAM /视觉SLAM为核心,结合IMU的高更新频率(100-1000Hz)与轮速计的位移数据,构建紧耦合定位系统,弥补SLAM在快速运动中的精度短板,实现厘米级连续定位;

●动态环境干扰场景(如密集人群、移动车辆):结合感知模块的动态物体过滤技术,移除移动障碍物对SLAM建图与定位的干扰,确保定位地图的准确性。

多源定位融合的核心算法为卡尔曼滤波(EKF)与粒子滤波(PF),卡尔曼滤波实现线性系统下的实时数据融合,粒子滤波则适配路口、狭窄通道等多模态定位问题,确保复杂场景下的定位稳定性。

低速感知定位技术的商业化落地关键:场景定制与成本优化

低速无人驾驶感知定位技术的发展,始终围绕“商业化落地”这一核心目标,其技术创新的关键并非追求“极致性能”,而是实现“场景定制化”与“成本最优化”的平衡。

一方面,针对园区配送、机场接驳、矿区运输、城乡物流、环卫作业等不同低速场景的特性,进行感知定位技术的定制化设计:如矿区场景强化传感器的抗粉尘、抗振动能力,采用激光SLAM+毫米波雷达的强鲁棒性方案;城乡物流场景侧重成本控制,采用视觉SLAM+低成本摄像头+超声波雷达的轻量化方案。

另一方面,通过技术创新与供应链整合实现成本优化:如固态激光雷达的规模化应用降低硬件成本,轻量化深度学习算法减少车载计算平台的算力需求,后融合策略降低系统集成成本。最终实现感知定位系统的成本与性能匹配低速场景的商业需求,为低速无人驾驶的规模化落地奠定技术基础。

技术趋势:软件定义感知,场景化算法持续迭代

未来低速无人驾驶感知定位技术的发展,将朝着“软件定义感知、算法驱动性能”的方向演进。随着传感器硬件的标准化、低成本化,感知定位的性能差异将更多体现在算法层面:通过场景化的算法迭代,提升传感器数据的利用率,实现 “低成本硬件 + 高性能算法” 的组合;同时,依托车云协同技术,将部分复杂的感知计算、地图更新任务迁移至云端,降低车载平台的算力压力,实现感知定位系统的轻量化与智能化。

感知定位技术作为低速无人驾驶的 “基础能力”,其场景化设计与低成本实现,将持续推动低速无人驾驶在各垂直领域的商业化渗透,让智能驾驶技术真正融入园区、机场、城乡等民生场景。

闽公网安备

35021102001059号

闽公网安备

35021102001059号